项目背景

无人机自主降落是无人机迈向全自主化的核心技术之一。针对无人机在复杂环境下精准降落的工程难题,本项目提出融合传统图像处理与深度学习的混合视觉引导方案,获南京航空航天大学校级创新创业项目立项并获经费支持。

项目最终获评南京航空航天大学"校级优秀创新创业项目"。

核心技术贡献

- 负责核心视觉识别算法开发,融合传统图像处理与 YOLO26n-RepVIT 深度学习模型

- 完成数据采集、标注、模型训练与调优,复杂场景下将引导标识检测准确率提升至 85%

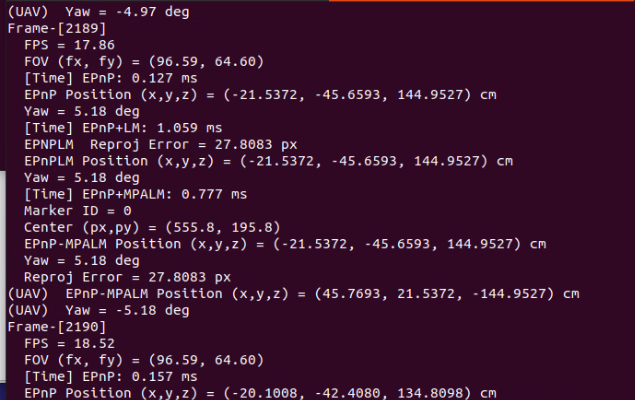

- 利用 OpenCV 计算空间坐标,实现无人机与降落平台的相对位姿解算

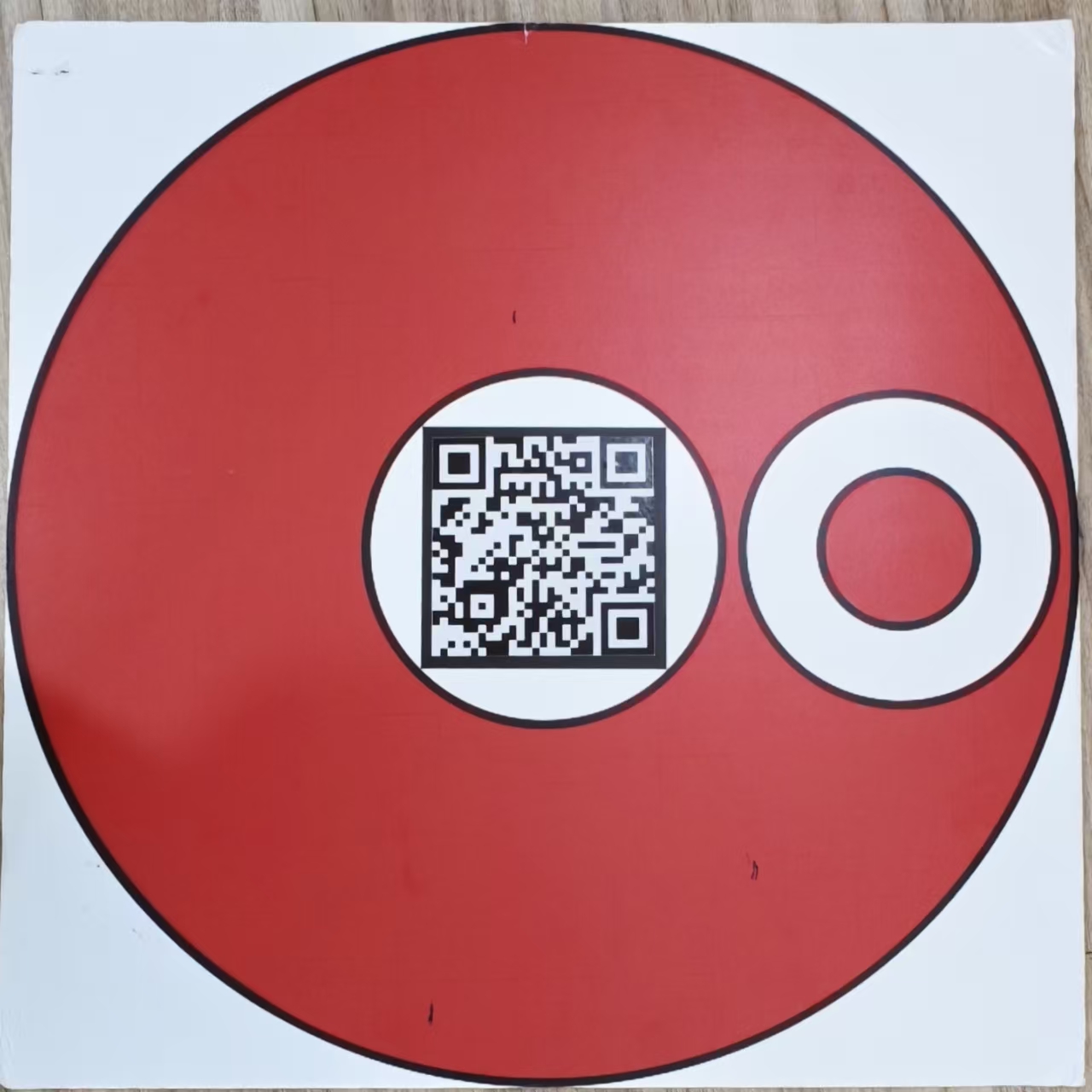

- 设计多级识别引导标识,支持远距离(>10m)、中距离(2~10m)、近距离(<2m)三级检测切换

- 基于 Python + PyTorch 搭建完整算法 pipeline,实现实时检测与位姿输出

- 使用奥比中光(Orbbec)深度相机进行深度信息采集,辅助三维定位

技术栈

系统演示 - 检测效果

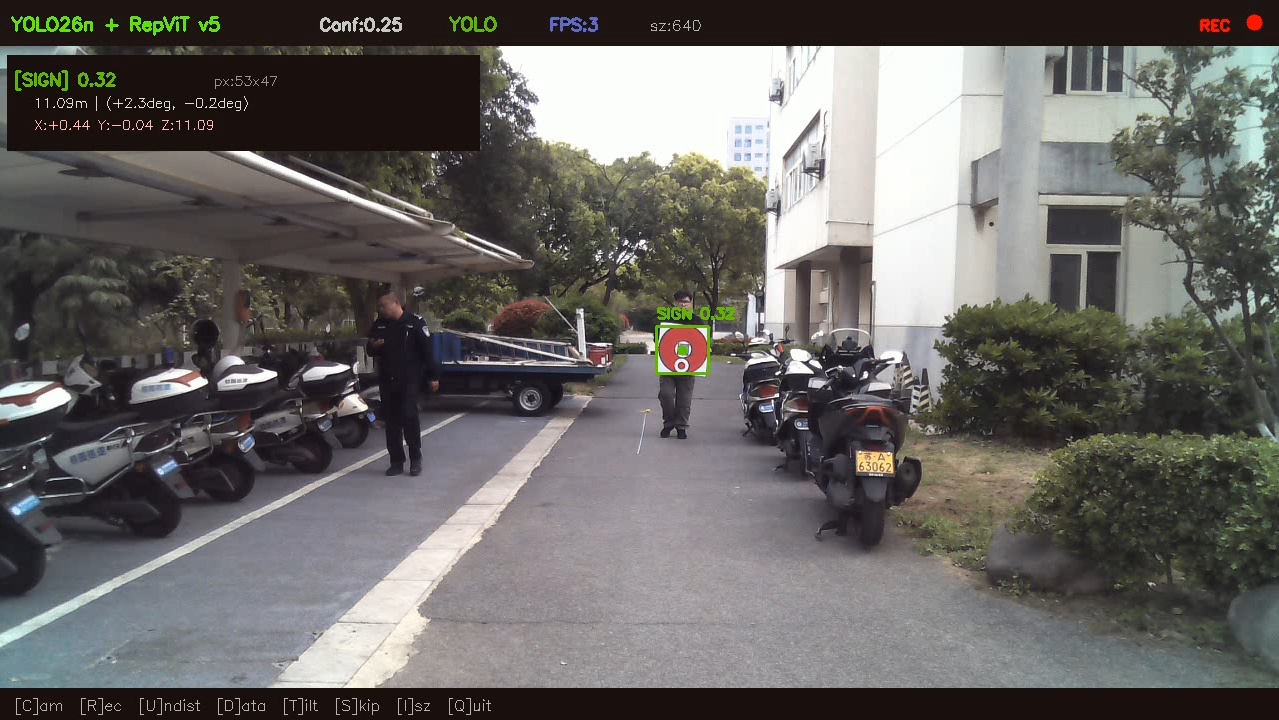

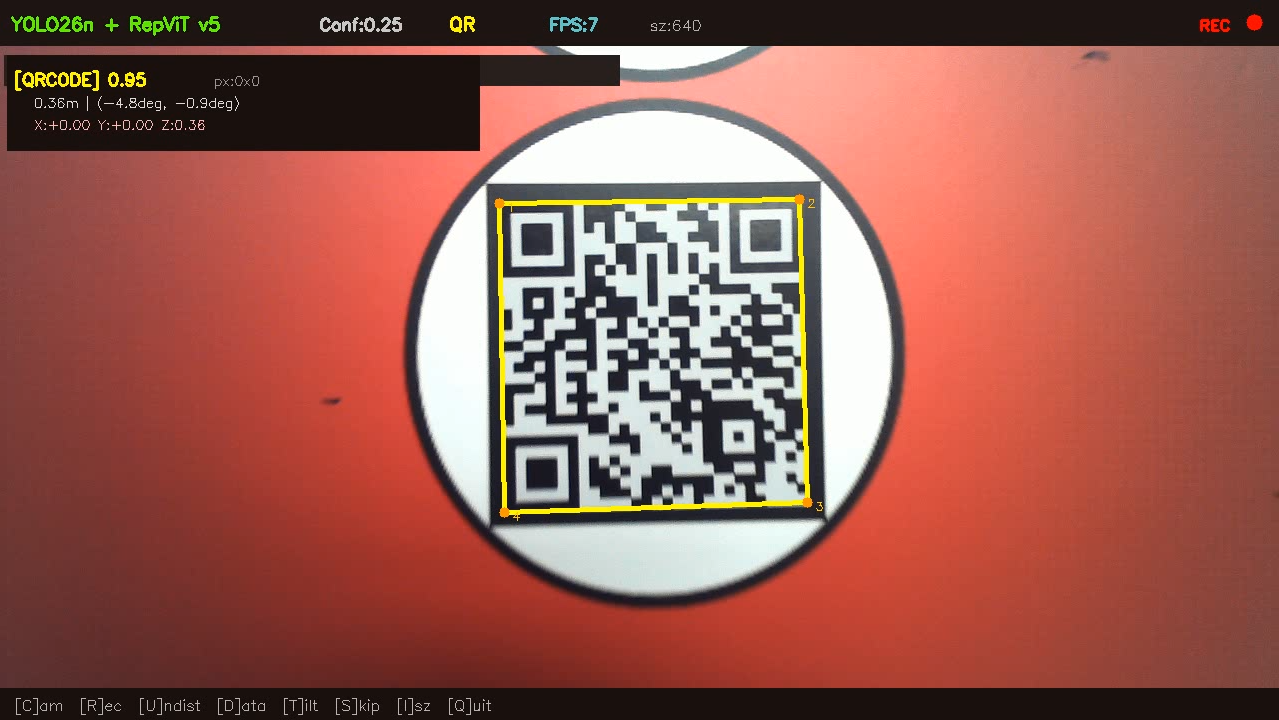

以下为算法在不同距离下对引导标识的识别效果:

远距离识别(>10m)

中距离识别(2~10m)

近距离识别(<2m)

位姿解算输出(6D姿态)

引导标识设计

多级引导标识实物设计

奥比中光深度相机系统

检测效果视频

以下为无人机视觉引导系统的实际检测演示视频:

视频:无人机视觉引导系统实时检测演示

项目成果

- 项目获评南京航空航天大学"校级优秀创新创业项目"

- 在复杂背景下,引导标识检测准确率稳定在 85% 以上

- 实现完整的检测-定位-位姿解算算法链路,支持实时输出

- 形成了一套可复用的无人机视觉引导标识设计规范